Me encuentro en la consulta pacientes preocupados por la IA, me he permitido llamarles pacientes Chat-Gpt, y también me permito compartir lo que veo respecto a esta nueva situación. Te lo cuento en el post.

Bombardeo de información y redes sociales

El bombardeo de información en las redes sociales es inmenso. Y en dermatología, la mayoría de la información no está en manos de dermatólogos. Esto no lo digo yo, lo dicen los datos publicados.

Competir con los influencers es imposible: somos menos, tenemos menos visibilidad y, además, nosotros tenemos que cumplir ciertas normas. Por un lado, no podemos hablar de medicamentos —paradójicamente ellos sí— y por otro, debemos atenernos al código deontológico del Colegio de Médicos, que puedes consultar aqui.

Ese código, que algunos pueden considerar limitante, en realidad nos da marco y sentido como profesionales. See trata de no alarmar con el cáncer, ni de lanzar mensajes de “todo o nada”, ni de prometer resultados inmediatos. Se trata de transmitir con rigor, con mesura, como si estuviéramos en la consulta. Con criterio clínico, con empatía y con humanidad. Y sobre todo teniendo en cuenta el nivel de comprensión del publico, que puede no entender nuestro lenguaje por completo y en situaciones de preocupación, alarmarse.

Hasta ahora, las redes como Instagram, Facebook, TikTok o Twitter (ahora X) regulan su contenido con ciertas normas. Puedes denunciar una publicación si consideras que es engañosa o peligrosa o sin moral, y en principio, hay mecanismos de moderación. Aunque mejorables, al menos existe una vía. Eso sí, si sigues los consejos de un influencer o de una cuenta sin formación sanitaria, corres el riesgo de estar mal aconsejado. Y eso, claro, depende del criterio del seguidor.

Podríamos abrir aquí un melón enorme sobre adolescentes y madurez digital, pero no es el tema de hoy.

Pacientes Google

He podido vivir la aparición del fenómeno “pacientes Google”, esos que llegaban informados a la consulta tras haber buscado en internet. Esto comenzó a notarse diría que hacia 2013 o 2014, hace unos 10 años.

Recuerdo que, entonces, al buscar enfermedades de la piel te aparecían comentarios en foros de coches o de mujeres. No está mal, al menos había experiencia en primera persona. Pero aquello nos empujó a algunos profesionales a comenzar a escribir de salud con propiedad, para que se pudiera encontrar información fiable, médica, en internet.

Luego llegaron las webs de salud de autoría desconocida o no sanitaria, redactadas por escritores, periodistas o redactores generalistas, y eso obligó a Google a ajustar su famoso algoritmo. Y ahí seguimos, con cambios continuos y con esa sensación de que hablar de salud en internet es cada vez más complicado, pero más necesario. Los profesionales luchamos en autoría aún con revistas de moda, magazines y otros medios.

Los temas de salud se consideran por Google de muy alta importancia, lo que nos coloca en una categoría especial: la del contenido sensible que puede afectar a la vida o a la seguridad del lector.

“Your Money, Your Life”: el contenido que importa de verdad

Los temas de salud están catalogados por Google como “Your Money, Your Life” (YMYL), es decir, contenidos cuya mala gestión puede afectar directamente a la salud o al bienestar del usuario. Por eso, en estos últimos años Google ha empezado a medir el famoso EEAT: experiencia, especialización, autoridad y fiabilidad (por sus siglas en inglés).

Esto significa que ahora importa quién escribe los contenidos de una página web y qué autoridad tiene esa web en concreto. Pero no es tan sencillo.

En otros sectores, la autoridad se mide por el número de enlaces que apuntan a una página. En salud, eso no basta. Aquí, Google parece, posiblemente, usar revisión manual, es decir, que no solo son algoritmos: hay personas detrás evaluando. O al menos eso parece, porque Google nunca explica del todo cómo hace sus algoritmos, solo da pistas.

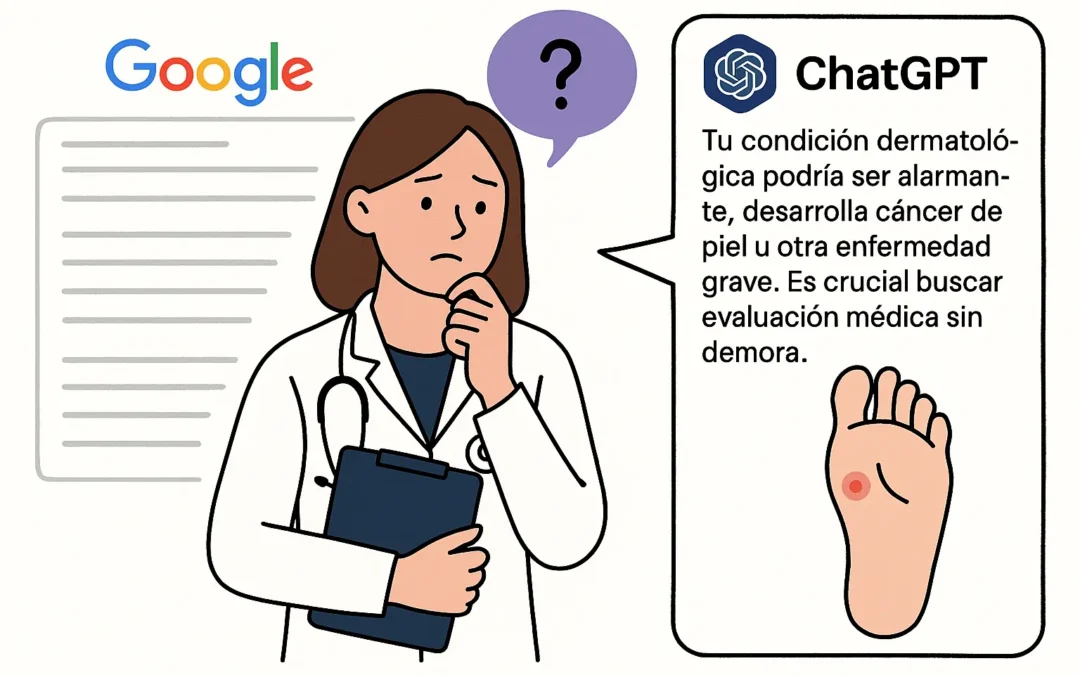

Ha llegado ChatGPT, sin sentir lo que produce en el lector

Y ahora ha llegado ChatGPT, y ha superado a Google en velocidad, en redacción, en acceso. Ya está. La revolución ha entrado en la consulta. Y la primera consulta de una SERP, de una página de busqueda en google, esta diseñada por la IA.

Los médicos estamos acostumbrados a los pacientes informados, y así debe ser: tienen derecho a saber, a entender, a participar. Pero en los últimos meses estamos viendo consultas de pacientes que vienen asustados con diagnósticos hechos por la IA. Y esto no es tan fácil de resolver.

Google va a tener que regular esta situación, porque su propia IA no tiene EEAT ni cumple ningún código deontológico. Y eso, en salud, no se debe pasar por alto. Cuando, desde mi punto de vista, aún no ha conseguido regular la autoridad de las páginas de salud, y así, magazines aparecen antes en resultados de búsqueda que los propios médicos escribiendo. Ahora utiliza esas propias clasificaciones, su algortimo, en mi opinión, aún no pulido en salud, como fuentes para una unica respuesta en una página de busqueda. Es decir, que su resultado de salud puede venir, como asi he comprobado, de páginas no controladas por médicos. ¿Dónde esta el «Your money your life»?

Limitaciones de Chat-GPT y la IA en los pacientes

Me he encontrado en consulta con pacientes realmente angustiados por respuestas dadas por ChatGPT. Os pondré ejemplos en los pantallazos, pero resumo las limitaciones más importantes que veo como médico:

Lo que ChatGPT no puede hacer (y un médico sí)

- No entiende de sentimientos.

Su forma de redactar no filtra. Usa términos que un médico no puede, o no debe, decir: crucial, radicalmente, imprescindible, necesario, preocupante… Palabras que pueden alarmar, y mucho, cuando quien lee está vulnerable. - Aprende del paciente.

Es decir, si el usuario empieza a corregirle o guiarle, la IA ajusta su respuesta en el prompt a lo que el paciente quiere oír. Esto no es información. - No tiene EEAT.

Y no puede tenerlo. Recoge datos de múltiples fuentes, pero ¿cuál es la correcta? ¿Cómo decide cuál priorizar? Muchas veces enlaza a revistas de belleza escritas por periodistas, no por médicos. Y aunque Google dé más autoridad a ciertas webs, eso no significa que esté escrito por un profesional sanitario. En medicina, la autoridad no la da el número de visitas: muchas revistas científicas ni siquiera están en abierto. - No tiene sentimientos.

Y este es, para mí, el punto más importante. Un médico es capaz de regular la conversación con el paciente e ir adaptando los contenidos de su información a su situación, a sus sentimientos y a su nivel de comprensión. He tenido pacientes sufriendo, literalmente, con angustia y ansiedad provocadas por diagnósticos de ChatGPT. Y esto la IA no lo sabe ni lo sabrá. Porque no puede.

Pacientes Chat-Gpt: Conclusión

Estamos en un momento de cambio profundo. La IA ha llegado a las búsquedas y a las consultas, y con ello va a cambiar también la forma en que entendemos la información en salud.

Pero Google tiene que actuar. Si no se adapta, todos los avances que se habían hecho con el YMYL, en mi opinión añun mejorables, se van a ir al traste.

Creo, sinceramente, que ChatGPT y la IA son herramientas valiosísimas, sin parangón. Pero no pueden regular el efecto emocional que provocan. Y eso, en medicina, es un gran hándicap. Aunque al final pongan la coletilla de recuerde consultar a su médico si tiene alguna duda.

La Dra Fernández-Guarino es dermatóloga, profesor acreditado de Grado en Medicina por el Ministerio Nacional de Educación y esta página esta acreditada por Seaformec, el Consejo Profesional Medico de Acreditación.

En Madriderma, nuestros dermatólogos están comprometidos con la salud y el cuidado integral de la piel. Si necesitas nuestra ayuda puedes pedir cita en nuestra clinica privada directamente online en los siguientes enlaces.